iLoveGayPorn

Archon Susceptor

- Messages

- 2,388

- Reaction score

- 3,271

Вот что бывает, когда таблетки пить забываешь. Но клип конечно топ.

Клип охуительный, он у меня сука на репите уже месяц.

Я тут вспомнил свое давнее творчество.

Прям как на иннове былодалбаёбы играют в лучь и радуются хуёвой графикой которую каждый школьник может в редакторе сделать,лохов заставляют альфатестить сырую хуйню а эти далбаёбы ещё и бабки платят я в ахуе. за донат там прямо с гмшопа можно купить повышеные рейты для кача, окна и любое количество адены и все это официально -вкинул бабки,продал монеты через минуту оделся в топ шмот ,2 окна и рейты в 2 раза выше чем у бомжей, это пиздец я такого дна еще не видел мамонтов как лохов используют по максимуму а они еще и рады

Ахаххпхпхпхпахаппппп, веселуха уххахахаха)))))Лысая рожа настолько не стесняется раздевать обычных людей на деньги что публично обо вёсём пишет с угрозами "платите только мне и никому другому , иначе мы закроемся ", при этом банит всех по кд кто пытается позариться на его кошелёк. все понятно для чего был открыт проект и на кого но рассчитан

противное отношение к игрокам где прямо у админа можно купить фулл обвес, окна, рейты,баффы и другие плюшки, даже не в тени, как делают это на всех проектах, а открыто и легально напрямую - это полное не уважение к остальным

View attachment 20969

View attachment 20971

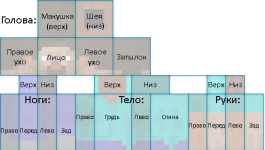

Еще раз: если ты делаешь другую модельку с другими полигонами, то очевидно что текстура не подойдет. Попробую максимально упростить свою мысль.Да, возможно с 2012 понятия полигонов, моделей и текстур изменились. Но когда я делал чисто ради интереса игру с кучей типовых головолок, то делал модели и натягивал текстуры, и даже анимацию простенькую делал ( https://gamestracker.org/torrents/pc/action/arkaim/15-1-0-19903 ).

Возможно, или я не понял, или меня не поняли. Не сильно понимаю, к чему столько грубостей в такой стене текста. Наверное, что-то в жизни у вас не так, если вас так сильно задевает. Может стоит перечитать моё сообщение и понять его смысл? =)

Может мы о разных проектах говорим? Так как я оЕще раз: если ты делаешь другую модельку с другими полигонами, то очевидно что текстура не подойдет. Попробую максимально упростить свою мысль.

Я возьму майнкрафт для примера, потому что там очень низкополигональные модели, не такие как в ла2, но хорошо демонстрирующие суть проблемы.

View attachment 20979

View attachment 20980

Невозможно текстуру для человечка из майнкрафта натянуть автоматом на модель с совершенно другой геометрией.

Так понятнее что я имею ввиду? Нейронка не может это сделать адекватно от слова совсем.

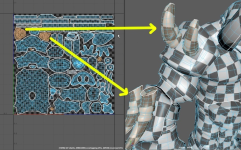

А модели менять придется, потому что иначе это будет примерно вот так смотреться

View attachment 20981View attachment 20982

То есть мы получили реалистичные текстуры, но используем старую низкополигональную геометрию, это выглядит еще более странно. Там где раньше была игровая условность в виде кубов и это соотвествовало текстурам, при повышении разрешения текстур появился реализм который требует реализма моделей, иначе квадратность выбивается и бросается в глаза.

В линейке это будет еще более заметно, потому что многие локации это большие ровные поля с минимум декораций.

Мы с Вами не в личной или деловой переписке, я как форумный персонаж общаюсь с другим форумным персонажем в рамках той роли которую я отыгрываю на данном форуме. Если лично Вас это задевает вне контекста форума, то давайте просто не будем вести дискуссию, потому что у меня нету цели нанести вам моральный ущерб.

Я не знаю точный процент моделек которые они переделали, но в какой то момент на это забили и начали оставлять дефолтные т.к. ресурсов на это не было.Может мы о разных проектах говорим? Так как я ои подобных видео, где модели с ноля делались и текстурировались. Может они отказались от них в итоге?

Ок, значит модели не используют новые, это было достаточно сказать. Но в случае, если бы модели были новые, то текстуры подтянуть можно было бы автоматом. Да-да-да, существуют уже механизмы, которые по развёртке и модели понимают, что это за предмет и апскейлят его, добавляя (додумывая) даже детализацию. Например:на это забили и начали оставлять дефолтные

1. Модели старые, но нужны новые т.к. локации пустые и уровень детализации окружения не соотвествует "современной" графике. Нейросети не способны сделать модели вменяемого качества.Ок, значит модели не используют новые, это было достаточно сказать. Но в случае, если бы модели были новые, то текстуры подтянуть можно было бы автоматом. Да-да-да, существуют уже механизмы, которые по развёртке и модели понимают, что это за предмет и апскейлят его, добавляя (додумывая) даже детализацию. Например:

- NVIDIA RTX Remix

- При ремастеринге старых игр RTX Remix берёт UV-развёртку, определяет объект (например, «это дверь», «это камень»), и через нейросеть перерисовывает текстуры в более высоком разрешении.

- Сеть ориентируется на 3D-модель и UV-карту, а не просто на плоское изображение.

- Ограничение — заточено под их экосистему и игры на DX8/9.

- Adobe Substance 3D Sampler / Painter (с AI Upscale)

- Новые версии умеют «понимать» модель через UV и AI-based upscaling.

- Можно загрузить модель с UV, и апскейл пойдёт с учётом того, где на 3D-модели находится каждая часть.

- Это ближе к semantic upscaling — сеть понимает, что вот тут металл, а тут кожа, и подбирает соответствующую детализацию.

- Kaedim 3D + Meshcapade AI

- Оба сервиса могут по UV апскейлить или перегенерировать текстуры, учитывая геометрию.

- Работает через распаковку UV в 3D-контексте, апскейл в текстурном пространстве, потом обратную упаковку.

- Custom pipeline с Blender + ControlNet / Stable Diffusion

- В Blender можно развернуть модель в UV space, прогнать её через Stable Diffusion с ControlNet (режим Inpaint + Tile Upscale), где ControlNet знает UV-маску.

- Так можно апскейлить с пониманием, где что находится, и даже стилизовать под нужный материал.

К счастью, я понимаю о чём вы говорите, но не слышите меня, считая, что такие механизмы являются фантастикой =) Технологии очень быстро развиваются. =) Было бы желание, автоматизировать можно было бы =)

ЕЕеее, я победил =))) Нет, вы просто не слышите исходное условие - что "если бы модели они сделали новые, но сейчас использовали текстуры старые" тогда .... Вот. Но я не спорю, я говорю, что при должном желании и текущих технологиях ВОЗМОЖНО автоматизировать, и что это уже делается. Но для вас или идеально, или никак. Но Л2 пиратка не ААААААААА проект, чтобы быть вылизанным до идеала =))))1. Модели старые, но нужны новые т.к. локации пустые и уровень детализации окружения не соотвествует "современной" графике. Нейросети не способны сделать модели вменяемого качества.

2. Апскейлинг старых текстур в лоб не имеет смысла т.к. модели нужны новые.

3. Не один из предложеных вариантов не выдает достойный результат, то что делает нейросеть не годиться для продакшена. Это надо очень долго править и доводить до ума.

4. Оптимизация начинается с размеров моделей и переиспользования текстур и т.д. Нейроесть не может это делать адекватно. Если принуждать к ограничеиям по размеру в полигонах нейросеть не способна понять какую часть можно упростить, а какая имеет больший вес с точки зрения визуала. Это все кастом который надо сложно и долго тренировать и на эту нужна компетенция, из коробки нету готовых решений. Есть рекламные слоганы для инвесторов.

Я умываю руки, это спор с разной теоретической базой, у вас какие то фантазии насчет вашего понимания вопроса на основе беседы с нейросеткой.

https://ru.wikipedia.org/wiki/Эффект_Даннинга_—_Крюгера

И те 144 рисованные)

Согласен, делать % опыта каким-то ресурсом - очень большая ошибка геймдизайна Харбора. В итоге ПВП отсутствовало. Последний раз я участвовал в ПВП еще в руинах на ТИ, и то, потому что @Imbalanced забайтил нас влезть в авантюру. Я сдох первый, если что.лаго 0.50% потери опыта при пвп дарят желание не боятся его)

А то - ой… я 7 часов качал эти 5%, не буду флагаться ….

Еще раз: если ты делаешь другую модельку с другими полигонами, то очевидно что текстура не подойдет. Попробую максимально упростить свою мысль.

Я возьму майнкрафт для примера, потому что там очень низкополигональные модели, не такие как в ла2, но хорошо демонстрирующие суть проблемы.

View attachment 20979

View attachment 20980

Невозможно текстуру для человечка из майнкрафта натянуть автоматом на модель с совершенно другой геометрией.

Так понятнее что я имею ввиду? Нейронка не может это сделать адекватно от слова совсем.

А модели менять придется, потому что иначе это будет примерно вот так смотреться

View attachment 20981View attachment 20982

То есть мы получили реалистичные текстуры, но используем старую низкополигональную геометрию, это выглядит еще более странно. Там где раньше была игровая условность в виде кубов и это соотвествовало текстурам, при повышении разрешения текстур появился реализм который требует реализма моделей, иначе квадратность выбивается и бросается в глаза.

В линейке это будет еще более заметно, потому что многие локации это большие ровные поля с минимум декораций.

Мы с Вами не в личной или деловой переписке, я как форумный персонаж общаюсь с другим форумным персонажем в рамках той роли которую я отыгрываю на данном форуме. Если лично Вас это задевает вне контекста форума, то давайте просто не будем вести дискуссию, потому что у меня нету цели нанести вам моральный ущерб.

А вот тут хер ты проверишь, что ты там покупаешь. Точнее продаешь монеты (коины, колы или что там у вас) за адену какому-то ноунейм трейдеру. Которого посадили админы с лярдом рисованной адены, "добытой кем-то", агаТы покупаешь игровое, добытое кем то, а не рисовку)

Если зайти дальше, то чем отличается нарисованная админом от выбитой с Мобов? И то и то появляется из воздуха… Спор не имеет смысла. Просто легальная покупка за реал и всё, чтобы не через площадки разные, которые все равно будут. В этом и проблема передаваемых предметов и валюты. Но если таких предметов не будет, то и рынка в игре не будет… Замкнутый круг.А вот тут хер ты проверишь, что ты там покупаешь. Точнее продаешь монеты (коины, колы или что там у вас) за адену какому-то ноунейм трейдеру. Которого посадили админы с лярдом рисованной адены, "добытой кем-то", ага

Да ну, привет. Отличается как минимум двумя пунктами:Если зайти дальше, то чем отличается нарисованная админом от выбитой с Мобов?

Нехуя се ты базу выдалЕсли зайти дальше, то чем отличается нарисованная админом от выбитой с Мобов? И то и то появляется из воздуха… Спор не имеет смысла. Просто легальная покупка за реал и всё, чтобы не через площадки разные, которые все равно будут. В этом и проблема передаваемых предметов и валюты. Но если таких предметов не будет, то и рынка в игре не будет… Замкнутый круг.